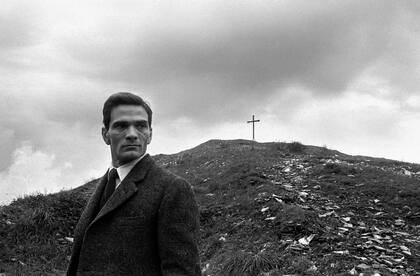

Un poeta y cineasta en la mira por marxista, intelectual desafiante y homosexual declarado

En los años 50, el poeta y cineasta debió enfrentar más de 30 juicios, perseguido por sus películas, por su obra literaria y por ser homosexual declaradoSuscriptores

Guadalupe Treibel

Lo suyo era la provocación benéfica, carente de especulaciones, de ataduras, de prudencia”, definió el escritor Alberto Moravia las motivaciones de su gran amigo, quizá el poeta y cineasta más procesado de la historia italiana. Es decir, Pier Paolo Pasolini. Un artista que, en su dinámica y apasionada vida, supo pronunciarse contra el fascismo, el conformismo burgués, la corrupción de la conciencia, la naciente sociedad de consumo. Un espíritu libre naturalmente transgresor que sacudió a la Italia de la posguerra, pese a tener claro que su obra se prestaría a represalias en un país de muy marcado catolicismo que, ciertamente, lo puso en la mira por marxista, intelectual desafiante y homosexual declarado. A punto tal que debió afrontar 33 juicios –y alrededor de cien denuncias– por los cargos más variados.

“Fueron procesos montados sobre la nada, hijos de una época en la que la ley todavía la llevaban jueces y fiscales formados durante el fascismo”, señala el periodista e historiador Paolo Mieli sobre el tormentoso vínculo del artista con una Justicia que lo sentó reiteradamente en el banquillo por considerarlo una amenaza a valores largo tiempo establecidos. “Escandalizar es un derecho, y ser escandalizado, un placer. Quien rechaza ese goce, es un moralista”, diría Pasolini en una de sus últimas entrevistas, poco antes de ser brutalmente asesinado en un baldío de Ostia, en 1975. Conocemos aquel lugar apartado: lo vimos en Caro diario, cuando Nanni Moretti viaja hasta allí en su Vespa a modo de sentido homenaje.

El crimen de Pasolini nunca fue del todo esclarecido, aunque se presume que pagó con su vida por haber señalado la connivencia entre la mafia y los demócratacristianos. Ni siquiera ese hecho sangriento puso fin a la persecución judicial: el caso contra Salò o los 120 días de Sodoma, su último film –estrenado en forma póstuma–, solo se cerró años después de su muerte. Con sentencia favorable, después de ser vilipendiado, denunciado, confiscado por “ofender el sentido moral del hombre común” con “perversiones sexuales carentes de valor artístico”. Se ha dicho que mientras rodaba esta cinta advirtió a sus colaboradores: “Esta película desatará una guerra”.

Acusado, entre otros epítetos, de “pornógrafo de izquierda”, Pasolini dedicó su vida a un cine audaz y profundamente personal

Acusado, entre otros epítetos, de “pornógrafo de izquierda”, Pasolini dedicó su vida a un cine audaz y profundamente personalEn el panteón del séptimo arte figuran films como Mamma Roma, El Evangelio según San Mateo, Teorema. También la citada Salò, sin duda su obra más perturbadora, donde traslada una novela del marqués de Sade al corazón de la república fascista de Salò, estado títere de la Alemania nazi, para hablar sobre el “mal radical” kantiano que corrompe y manipula las almas junto con los cuerpos. En esta pieza, cuatro poderosos –un duque, un obispo, un juez y el presidente– orquestan redadas, ayudados por milicianos y soldados. Secuestran a jóvenes que, durante días, serán objeto de burla, humillación y tortura, sometidos al placer sádico de sus captores. La escalada del horror es indecible; el infierno se impone: chicas y muchachos son obligados a arrastrarse desnudos, forzados a comer excremento, lacerados sus genitales…

“El desprecio de Pasolini por el conformismo y su deseo de acercarse a los sectores más marginales –sentimientos que alimentaron su obra insurgente– lo volvieron una presa conveniente para la agresión legal”, considera el periodista Daniele Ongaro, guionista de Il Santo Infame (2015), documental emitido por la señal Rai Storia que reconstruye el calvario judicial del creador italiano. Ongaro fecha la primera embestida “en 1949, cuando una denuncia reveló públicamente su homosexualidad y tuvo que abandonar su amado Friuli para trasladarse a Roma”. Se iniciaba así un incesante derrotero de ataques para el entonces joven maestro de Letras y poeta.

Poesie a Casarsa, del 42, fue su primer libro de poemas, y está escrito en friulano, para honrar el dialecto de su amada madre, Susanna Colussi, idioma local que “que hablamos mientras comemos y respiramos”. Y para plantarle cara al fascismo, que buscaba barrer por la fuerza con las lenguas campesinas, “vulgares”. Fuente de agua de mi pueblo / No hay agua más fresca / Fuente de rústico amor, abría aquel poemario que, décadas más tarde, PPP reescribiría del siguiendo modo: Fuente de agua de un pueblo que no es mío / No hay agua más vieja que la de aquel pueblo / Fuente de amor para nadie.

Cine y controversias

Pasolini llegó a la ciudad de las siete colinas con 27 años, acompañado de su progenitora. En aquel entonces, la capital –todavía con huellas de la Segunda Guerra– se expandía y recibía olas de migrantes que se instalaban en los márgenes, el borgate; o sea, los barrios pobres. Esta es la Roma que recibe al poeta, la que se convertirá en fuente de inspiración y de encuentros casuales, fugaces. “Trabajo todo el día como un monje, y por las noches merodeo como un gato en busca de amor”, reconoció sobre su costumbre de deambular solitario por los arrabales, aprendiendo las reglas de la calle de la mano de los caídos de sistema. A ellos, los ladronzuelos y matones que frecuentaba, les dedicó Ragazzi di vita, su primera novela.

La trama sigue las andanzas de jóvenes abandonados a su suerte que buscan sobrevivir a cualquier costo. Ríen, juegan, roban, buscan comida en los basureros, pelean, se prostituyen: es el rostro inquietante de una humanidad cruda, sin moralidad y sin culpa, en ocasiones con destellos de compasión. Cuando salió en 1955, Ragazzi di vita fue un éxito rotundo: Pasolini retrataba la vida de los rezagados valiéndose del romanaccio, su dialecto, elección que fastidió a los círculos democristianos. El asunto escaló, por supuesto: la Fiscalía de Milán interpuso una denuncia contra el autor y la casa editorial por publicar “obscenidades”. Pier Paolo se defendió alegando realismo, bancado por figuras de gran relieve como el poeta Giuseppe Ungaretti y el crítico literario Carlo Bo, que testificaron en su favor. ¿El veredicto? Tanto el escritor como sus editores fueron absueltos del supuesto delito.

El suceso de Ragazzi di vita trajo grandes cambios para el todavía profesor de literatura: nuevo trabajo (como dialoguista para films de Federico Fellini, de Mauro Bolognini); nuevo domicilio (en el barrio residencial EUR); nuevos amigos (la incondicional Laura Betti, por ejemplo, actriz reconocida que se embarcaría en varios de sus films). Pasolini compra su primer coche, escribe otra novela exitosa, Una vita violenta. Y nace en él un deseo irrefrenable: experimentar como realizador de cine. O, como él lo llama, “la lengua escrita de la realidad”.

Tiene casi 40 cuando, en el 61, estrena su ópera prima: Accattone, sobre un ragazzo di vita que vive a expensas de una trabajadora sexual; al menos, hasta verse privado de esos ingresos, enamorarse e intentar –en vano– enderezar su vida. Blanco de una maliciosa campaña que trató de boicotearla por todos los medios, Accattone fue la primera película prohibida para menores de 18 en Italia, y le valió a su autor motes tan injustos como “pornógrafo de izquierda” y “poeta de los asesinos”. Fue en este contexto caldeado que se dio un episodio extraño que lo llevó nuevamente a tribunales…

A fines de 1961, se instaló en el pueblo costero San Felipe Circeo para avanzar en el guion de su próxima película, Mamma Roma, sobre la tragedia de una prostituta romana con un hijo al que adora y al que le oculta su doble vida. Una inolvidable actuación de Anna Magnani, rodeada de algunos chicos de la calle.

Durante esa escritura, para despejarse, una tarde el cineasta sale a dar una vuelta en coche, deteniéndose un momento en una estación de servicio, donde conversa unos minutos con el despachante de nafta. Al poco tiempo, el empleado se presenta ante los carabineros asegurando haber sido asaltado por Pasolini a punta de pistola. El arma estaba cargada de balas de oro, afirma. Y añade que había alejado al artista con un cuchillo para cortar salame. La acusación, cuando menos improbable, igualmente llegó a juicio.

Más que un juicio, se asemejó a una carnicería: con saña, se cuestionó la vida privada de Pasolini, se buscaron indicios de culpabilidad en sus novelas, se habló de él como un “enfermo mental”, se atribuyó su supuesta conducta delictiva a “su desviación sexual”. Al final, fue condenado a dos semanas tras las rejas por robo, más cinco días por posesión de una pistola que, en todo el proceso, nunca fue encontrada. Naturalmente apeló y, tiempo después, se le concedió la amnistía.

“La mayoría de los juicios terminaron con absoluciones en primera instancia o en apelación”, aclara Daniele Ongaro que, para escribir el guion de Il Santo Infame se asesoró con el Centro Studi Pier Paolo Pasolini di Casarsa della Delizia. A su entender, el cineasta enfrentó casi todos los procesos sin rodeos y de buen talante, aunque hubo una condena en particular que lo desanimó: ser incriminado por “denigrar la religión del Estado” en su cortometraje La ricotta. Según el guionista, “le dolió no haber podido convencer al jurado de que era una obra profundamente religiosa”.

Otra forma de religiosidad

La Ricotta formó parte del film colectivo Ro.Go.Pa.G (1963), titulado de este modo por las iniciales de sus directores: Rossellini, Godard, Pasolini y Gregoretti. Su episodio transcurre en una colina de la periferia romana, donde un director (Orson Welles) y su equipo están rodando una película sobre la crucifixión de Cristo. En un ambiente banal y burlón, nadie recala en el vía crucis personal de uno de los figurantes, un joven humilde que pasa privaciones y que, en un giro insólito, muere de indigestión en la cruz, atiborrado de ricota.

Durante el juicio, Pasolini declaró que su intención fue representar “la vulgaridad irónica, cínica, incrédula del mundo contemporáneo”, o sea, defender el sentido sacro de la religión al exponer cómo la modernidad la vuelve objeto burdo, profano, de espectáculo. La fiscalía lo llamó arrogante, lo increpó por “contorsionismo dialéctico”, logrando que el tribunal lo condenase a cuatro meses de prisión (con libertad condicional) en primera instancia, llamando a censurar ciertas partes del cortometraje.

Nótese la paradoja de que al año siguiente, y pese al rechazo inicial que provocó el anuncio del proyecto, su film El Evangelio según San Mateo le valiera el Gran Premio de la Oficina Católica Internacional en el Festival de Cine de Venecia. Asesorado por jesuitas, se mantuvo fiel a la letra Nuevo Testamento en esta pieza neorrealista de transparente belleza que es tenida hoy día como una obra maestra del cine cristiano por el Vaticano. “El evangelio no se puede interpretar: se dice a sí mismo”, declaró expresando su deseo de contar “una historia épica y lírica”. “Si preferí al discípulo Mateo antes que a Juan, Marcos o Lucas es porque es más popular e intransigente: narra la vida de un hombre que nació pobre y, tras una breve y dramática existencia, murió dando un mensaje de paz y amor a la gente”

Con El Evangelio llegó la calma… que precedió otras tormentas judiciales. Entre las más sonadas, las más de ochenta denuncias que recibió su adaptación de El Decamerón, de Boccaccio, en 1971.

Irreductible Pasolini

Tras rodar cintas como la controversial Teorema (con Terence Stamp) y Medea (con Maria Callas), Pasolini realizó en rápida sucesión tres films que constituyeron su “trilogía de la vida”. Inspirados en clásicos universales de la literatura, al ya citado título le siguieron Los cuentos de Canterbury (72) y Las mil y una noches (74), con los que quería reivindicar los placeres del cuerpo, la vitalidad alegre y liberadora del erotismo. Irónicamente, las protestas y agravios contra El Decamerón tuvieron el efecto contrario al pretendido por los censores: prácticamente la mitad de Italia se congregó en los cines para ver la debatida película de un realizador que, por aquellas fechas, muestra signos de desencanto ante una realidad que puede describir, mas no cambiar.

“De joven creía en la revolución, ahora estoy menos seguro. He borrado la palabra esperanza de mi vocabulario. Veo un mundo cada vez más terrible…”, declara en esta época, manifestándose un apocalíptico. Quizá por causa de ese desaliento ni siquiera se presentó a declarar cuando, como director del periódico de extrema izquierda Lotta continua, fue procesado por otro delito delirante: “Instigación de golpe de Estado”.

“Cuando era pequeño, mi mamá me contaba historias, fábulas. Ella era para mí como Sócrates. Tenía una visión del mundo ideal e idealizada. Todavía cree en la piedad, en la generosidad, en la caridad, en el heroísmo. Yo he absorbido todo esto de una manera casi patológica”, dijo en vida Pasolini sobre la amada maestra rural a la que consideraba la principal influencia de toda su obra y que lo sobrevive varios años.

En el docufilm Le donne di Pasolini (2023), de Eugenio Cappuccio, se refleja su vínculo entrañable con Susanna; también con María Callas, Laura Betti, Oriana Fallaci, que asimismo dejaron amorosa huella en Pier Paolo. Otros films y libros recientes han rescatado diferentes facetas de este artista de múltiples talentos, tan fecundo en realizaciones, constantemente perseguido por censores mojigatos. Seguramente surgirán nuevos títulos el año próximo, cuando Italia y el mundo conmemoren que han pasado cinco décadas del asesinato del irreductible Pasolini.

&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&

Ramón López de Mántaras: “Pronto no sabremos qué es falso y qué es real en internet”

El investigador y físico, pionero de la inteligencia artificial en España, pregona la necesidad de un marco regulatorio y analiza su futuro; sus recomendaciones para alcanzar una dieta digital

Ana D'Onofrio

PALMA DE MALLORCA.- La Inteligencia Artificial no es tan inteligente ni tan artificial. No entienden nada, ni lo que ven ni lo que dicen. Todavía no tenemos nada que merezca la pena ser llamado inteligente en la IA”. Así arrancó el profesor Ramón López de Mántaras una conferencia que ofreció hace un par de meses en el museo Es Baluard, de Palma de Mallorca, y el auditorio, colmado, estalló en aplausos. Pionero de la IA en España y fundador del Instituto de Investigación en Inteligencia Artificial del CSIC (Consejo Superior de Investigaciones Científicas), López de Mántaras, 72 años, catalán, no solo se caracteriza por su prestigioso currículum, sino por su postura frente al avance de la IA.

Su punto de vista, que bien podría calificarse de equilibrio crítico, salta a la vista cuando describe la “dieta digital” a la que se autosomete para protegerse de los efectos no deseados de ese mundo que tanto conoce desde adentro (ver abajo). Además, no pierde ocasión de pregonar cuánto necesita esta nueva tecnología de un marco regulatorio adecuado. De hecho, con Luc Steels (científico y artista belga, otra de las voces europeas de peso en este tema) ha sido el impulsor de la Declaración de Barcelona, un manifiesto que propone un uso adecuado de la IA en Europa.

Doctor en Física por la Universidad Paul Sabatier de Toulouse (Francia), master en Ciencias de Ingeniería Informática por la Universidad de Berkeley y doctor en Informática por la Universidad Politécnica de Cataluña, sin contar trabajos publicados y premios recibidos, López de Mántaras intuyó lo que quería hacer en su vida el 20 de julio de 1969, cuando estaba de vacaciones y próximo a cursar el último año de la secundaria. Sentado en el suelo del living de su casa en Sant Vicenç de Castellet, en Barcelona, no podía quitar sus ojos de la pantalla blanco y negro de la tele. En una epopeya histórica e inédita en la vida de la humanidad, Neil Armstrong y Buzz Aldrin caminaban por primera vez sobre la superficie de la Luna. Michael Collins, el tercero de la partida, esperaba en órbita lunar con el módulo de regreso de Apolo 11.

“Estaba impresionado –recuerda ante en una entrevista vía Zoom–. Caramba, me dije, ¿cómo puede ser esto? Cuando volví a clases le pregunté al profesor de Física. ‘Esto ha sido posible gracias a algo que se llama la electrónica’, me dijo. Y ahí lo decidí. Iba a ser ingeniero electrónico, y ese fue mi primer grado. Luego me becaron en Francia y me licencié en la especialidad control automático, que es una rama de la Física aplicada, después hice el doctorado con una tesis sobre algoritmos de aprendizaje de reconocimiento táctil de objetos aplicados a la Robótica. Y aunque oficialmente era una tesis doctoral en Física, de hecho ya era Inteligencia Artificial”.

–Pero no se la llamaba así…

–No, aunque la IA ya existía desde finales de los 50. Se la conocía muy poco y se la llamaba cibernética. La investigación empezó en los Estados Unidos y más tarde llegó a Europa. Cuando empecé el doctorado en Francia, en 1975, éramos muy pocos los que investigábamos en IA. Cuando terminé mi tesis, dos años más tarde, fue cuando de hecho descubrí que lo que hacía era IA y decidí dedicarme plenamente a este tema.

–Como pionero en España, ¿diría que tenemos que festejar el advenimiento de este “avance”?

–Bueno, un poco de todo, ¿no? Siempre hay debate cuando aparece una tecnología nueva: tiene las dos caras, el doble filo, el doble uso. Desde la energía atómica, o la energía nuclear, se han hecho cosas muy positivas, pero también cosas enormemente negativas como las bombas (atómicas). En función de cómo lo apliques será algo beneficioso para la sociedad o no. Y estamos viendo exactamente lo mismo con la IA. Sobre todo últimamente. Desde los 80, yo mismo y mucha gente más ya éramos conscientes de que teníamos ciertas responsabilidades sociales. Incluso fui uno de los primeros miembros de la Asociación Internacional de Informáticos para la Responsabilidad Social. Fomentamos congresos y debates sobre sus posibles impactos negativos.

–¿Cuáles serían esos impactos?

–Bueno, ahora, en este momento, con la Inteligencia Artificial Generativa el impacto ha empeorado. La IA Generativa es, por ejemplo, el ChatGPT. Lo que la gente ha visto en estos dos últimos años, y de lo que hablan los periódicos, todo eso es esta IA que llamamos Generativa. Genera texto. Genera imágenes falsas, imágenes generadas por ordenador que ¡pueden clonar personas! Incluso se puede clonar la voz. O sea, generar una voz que suene exactamente como la voz de la persona que queramos. Esto posibilita desprestigiarla, o usarla para desprestigiar a otro. Hay expertos que trabajan en eso. Por ejemplo, esta entrevista que estamos teniendo, por web, si se hace pública en YouTube, cualquier experto en IA puede hacer un clon mío, con mi voz o con la suya. La IA actual puede analizar mi voz, los rasgos de mi voz, también mi imagen y hacer un clon mío digital. Y me pueden hacer decir lo que no estoy diciendo, sino lo que ellos quieran que yo diga.

–Da miedo…

–Claro, y teniendo la voz y la imagen pueden hacer lo que quieran. Pueden crear imágenes para hacerte decir o hacer cosas delictivas. Se puede generar un video enormemente realista de alguien cometiendo un delito a través de su clon.

“Aún no tenemos nada en la IA que merezca ser llamado inteligente”, dice el académico

“Aún no tenemos nada en la IA que merezca ser llamado inteligente”, dice el académico–De esto se infiere que algunas pruebas, hoy válidas ante un estrado, podrían dejar de serlo.

–Claro que sí. De hecho un juez, en un debate en el que participé, afirmó que temía que iba a llegar el momento en que un video donde se viera a una persona cometiendo un delito in fraganti dejaría de ser válido como prueba, porque si no tienen la seguridad de que ese video es real no lo podrían aceptar como prueba incriminatoria. Este es uno de los grandes problemas de la IA actual.

–En pocas palabras, la IA puede generar personas falsas.

–Claro, y esto debería estar penado de una manera muy estricta. Tanto las empresas como quienes generen esos videos falsos con esos propósitos. Mire, primero debería estar prohibido. O, si se hace, que aparezca en la pantalla un aviso que diga que no es real. O decir: esta persona que están viendo ustedes ha sido generada por IA.

–Como una marca de agua digital.

–Por ejemplo. Y si no se hace (si no se aclara) eso debería estar penado. Y si, además, las consecuencias de lo que hiciera el clon derivara en que la persona fuera acusada de algo serio, a la que cabría la posibilidad de procesar e incluso encarcelar, entonces la responsabilidad penal debería recaer en la empresa y los ingenieros que han generado el clon.

–Queda claro que la primera víctima de la IA es la verdad.

–Claro, exactamente. Ese es el gran problema. Y puede llegar un momento, y no está muy lejos desgraciadamente, de que sea prácticamente imposible saber qué es cierto y qué es falso. Las sociedades funcionan en base a la confianza entre nosotros. Confiamos en los demás. Confías en tu médico…, en fin. Una sociedad en la que prácticamente solo haya desconfianza entre sus miembros deja de ser una sociedad.

–La profecía orwelliana…

–Claro, y a partir de ahí empezamos a polarizar, a generar odio, y las consecuencias son nefastas. Significa cargarse la sociedad. Y esto es muy grave.

–Pero hoy por hoy no es un escenario imposible.

–Claro que no. Es posible que ocurra. Sobre todo si no se toman medidas. En estos momentos, el porcentaje de falsedades en internet es muy alto. Si no se toman medidas pronto casi todo será falso.

–¿Cómo va el tema regulaciones?

–Hay tres grandes polos de desarrollo de la IA, que son Europa Occidental, China y América del Norte (EE.UU. y Canadá). Los modelos que hay detrás son dispares. Me refiero a modelos en cuanto a tomar medidas por el impacto social de la IA. En los Estados Unidos el modelo está basado en los beneficios económicos, es el modelo de las grandes empresas tecnológicas Google, Amazon, Apple, Facebook, Microsoft... es decir, las más grandes, aunque también hay otras menos grandes, como OpenAI. En otras palabras, la mentalidad imperante en Silicon Valley, basada en que les dejen hacer, que no les regulen, intenta convencernos de que ya son conscientes del problema y que ya lo harán bien. En principio, no tengo por qué pensar, no hay pruebas al menos, que los responsables de esas grandes empresas actúen de mala fe. Pero el problema es que están obligados a obtener resultados económicos a corto plazo y esto los condiciona completamente. Están atrapados en una espiral competitiva enorme para ver quién se lleva el trozo de pastel más grande del mercado de la IA generativa, y por lo tanto dicen unas cosas y hacen otras. Y los gobiernos no se atreven a regular. Fíjese que California desarrolló una ley para regular la IA, pero el gobernador (NdeR: el demócrata Gavin Newson) la vetó.

–¿China?

–En China el gobierno lo decide todo “desde arriba”. Europa, en cambio, ha adoptado el modelo de la regulación y se ha consultado a miles de personas (yo fui consultado y muchos colegas míos). Se nos pidió opinión acerca de muchos aspectos de la ley europea de IA. Y no solo han preguntado al mundo académico. También han dado su opinión empresas, ONG, sindicatos de trabajadores. Está muy bien, pero eso no significa que el resultado tenga que ser óptimo, ya que hay muchos intereses enfrentados. Los empresarios y los sindicatos no coinciden en todo ni mucho menos. Y el mundo académico con el mundo empresarial tampoco.

–¿Y qué me dice de esa normativa?

–En esa normativa, sancionada en agosto pasado, hay cosas buenas y cosas no tan buenas, como, por ejemplo, la no regulación de las armas letales autónomas. La ley no está en vigencia porque es un proceso muy largo. Está muy avanzada, pero cuando se hayan completado todas las fases, la propia ley dice en un anexo “damos un año de tiempo para que las empresas europeas se adapten a la ley”. En mi opinión, esta ley no estará plenamente operativa y con posibilidades de sancionar hasta finales de 2025.

–Imagino que la investigación oficial y la privada en esta materia deben tener velocidades diferentes porque cuentan con recursos distintos.

–Sí, claro. Pero no solo por el dinero que tienen, sino porque tienen todos los datos… Las grandes empresas como Google tienen cantidades enormes de datos para poder entrenar estas IA. Y, además, requieren un hardware, es decir, unos procesadores que son muy costosos. Hablamos de centenares de millones de dólares. Entrenar GPT5, que todavía no está en el mercado, pero dicen que lo sacarán (ahora tenemos el GPT4 o extensiones del 4), puede llegar a costar una inversión que podría alcanzar mil millones de dólares, teniendo en cuenta que GPT4 ya costó del orden de 100 o 150 millones de dólares. Y eso en el mundo académico no podemos. No disponemos de tantos recursos económicos.

–Una carrera desigual.

–Y claro. Mire este dato: Google compró DeepMind, donde trabajan dos investigadores que han ganado este año el Nobel de Química porque lograron predecir las estructuras proteicas con IA (NdeR: se refiere al británico Demis Hassabis y al estadounidense John M. Jumper). Las grandes empresas como Google tienen tanto poder económico que se pueden permitir el lujo de tener a miles de personas haciendo investigación en temas que no sacarán al mercado mañana sino a muy largo plazo. Estas empresas hoy están suplantando el rol del mundo académico. Facebook y Meta hacen lo mismo. Antes las empresas no hacían tanta investigación fundamental. Ésta se hacía en el mundo académico. Ahora no. Ahora nos están desplazando. De alguna manera están marcando los ritmos de la IA.

–Esto también parece preocupante.

–Claro, porque no son ONG, sino empresas con la obligación de obtener beneficios y a lo mejor pueden tomar caminos que quizá los académicos no tomaríamos por cuestiones éticas.

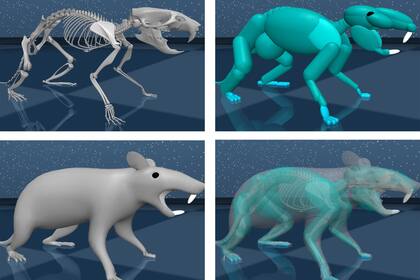

Investigadores de Harvard y de DeepMind crearon una rata virtual capaz de controlar movimientos complejos y coordinados del cuerpo, con el objetivo de ayudar a descifrar los mecanismos por los que el cerebro controla el movimiento de las extremidadesHarvard University

Investigadores de Harvard y de DeepMind crearon una rata virtual capaz de controlar movimientos complejos y coordinados del cuerpo, con el objetivo de ayudar a descifrar los mecanismos por los que el cerebro controla el movimiento de las extremidadesHarvard University–¿Qué peligros para la humanidad significan? Yuval Harari alerta sobre esto, por ejemplo.

–Sí, pero aquí hay que matizar bastante. Cuando Harari o incluso Geoffrey Hinton (NdeR: Premio Nobel de Física 2024) hablan de riesgo existencial están utilizando un lenguaje como si la IA tuviera iniciativa propia, objetivos propios, deseos propios, y esto es falso. No tiene nada de eso.

–¡Qué alivio! ¿Me asegura que nunca tendrá conciencia?

–No, en absoluto. Es imposible que tenga conciencia la IA. Le digo más, ni es tan inteligente ni es tan artificial como parece, ni entiende. Hay un problema con el uso de las palabras. Debería quedar claro que detrás de la IA hay un montón de personas que lo han hecho posible. Es una máquina que funciona con software, ¿no? Un software que lo desarrollamos y desplegamos nosotros. Pero esta gente lo que dice es: “La inteligencia artificial llegará a ser tan inteligente que existe el peligro de que decida controlar el mundo y poner en riesgo nuestra existencia”. Esta afirmación es completamente absurda. La IA es un instrumento formidable, muy sofisticado, pero sin iniciativa ni objetivos ni sentido común.

–¿Por qué cree que hay tantas voces alarmistas entonces?

–En mi opinión, están levantando una cortina de humo para que no hablemos de lo que realmente es peligroso en IA, que es lo que ya tenemos encima de la mesa. Lo que hemos hablado antes: la IA generativa. Que puede generar personas falsas y, además, es un riesgo para la privacidad y el control de la ciudadanía. Otro peligro son los sesgos de los algoritmos, que discriminan. En los Estados Unidos se implementó un sistema que aconsejaba conceder o no la libertad condicional a los acusados en función de la probabilidad de reincidencia. Y se demostró que detrás había un algoritmo que discriminaba a los afroamericanos. ¿Por qué? Pues porque los datos que entrenaron al sistema presentaban sesgos que discriminaban a ese colectivo. Un afroamericano apeló y solicitó que le explicaran los motivos de la denegación, pero el algoritmo no da explicaciones ni argumenta. El juez que lo usó, para ahorrarse el trabajo, no fue más allá del “consejo de la máquina”. El acusado ganó la apelación y puso en cuestión todo el sistema. No estoy en contra de usar estos sistemas para tomar decisiones, pero antes hay que analizar los posibles sesgos. A esto hay que atender.

–¿Cómo?

–Lo que hay que hacer es regular. Por ejemplo, que no se pueden usar algoritmos en la Justicia que tomen decisiones respecto a la libertad de una persona. No se debería tampoco usar algoritmos de IA para seleccionar candidatos a puestos de trabajo. Y en caso de no cumplir con la legislación, se debe sancionar. Pero no una relativamente pequeña sanción económica que para una gran empresa no represente ningún problema. Sino una sanción significativa y ejemplar.

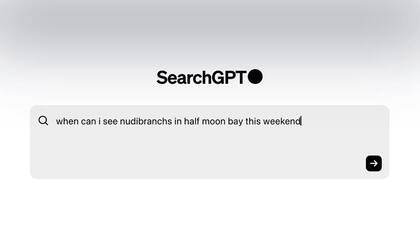

OpenAI ha anunciado que está probando el prototipo de un nuevo motor de búsqueda impulsado por Inteligencia Artificial llamado Search

OpenAI ha anunciado que está probando el prototipo de un nuevo motor de búsqueda impulsado por Inteligencia Artificial llamado Search–¿Con qué más se puede controlar?

–Regular es un aspecto. Otro es educar. Educar desde la primaria a la secundaria, educar en que la tecnología tiene su lado oscuro. Por ejemplo, en la Universidad Autónoma de Barcelona hay un nuevo grado de Inteligencia Artificial en el que yo mismo he colaborado en la definición de los contenidos de las materias y no solo nos hemos preocupado de formar expertos en los aspectos técnicos de la IA, sino también en la formación en aspectos humanísticos de la IA (filosofía, ética, psicología, sociología). Es decir que la parte humanista y ética de la IA tiene un peso enorme. Los primeros egresados que saldrán el año que viene habrán visto en clases que, aunque algo sea técnicamente posible de hacer, es preciso preguntarse: ¿lo debo hacer? Es importante que los futuros tecnólogos, científicos que trabajarán en IA se planteen esa pregunta. Es crucial educar de una manera más humanista y no puramente técnica a los futuros ingenieros.

–¿Usted cree que es sustentable la IA? Porque he leído que consume mucha agua, por ejemplo…

–Muchísima consume. Ya escribí en el periódico de Barcelona La Vanguardia sobre esto, y digo que la IA no va a solucionar el cambio climático sino todo lo contrario. Y que el incremento de demanda energética de esta IA Generativa es tan creciente que no es sostenible. La IA clásica, anterior a la Generativa, no requiere en absoluto este alto consumo de energía.

–¿Se refiere a la robótica, a la tecnología aplicada a la medicina?

–Sí, me refiero a sistemas que no son IA Generativa, que es la que consume muchísimo. Esa IA generativa, no se hablaba de ella hace tres años. En los laboratorios sí, algunos sabíamos que existía porque la veíamos en congresos académicos. Pero cuando OpenAI lanzó el ChatGPT (2022), la IA generativa explotó. Esta es la que consume tanto, afortunadamente la IA Generativa no es todo lo que se hace en IA. Todavía hay mucha actividad en modelos de razonamiento, modelos en planificación, aprendizaje con métodos distintos que no tienen nada que ver con la IA Generativa.

–Hábleme de la parte buena de la IA.

–Bueno, hay mucho. Tiene un potencial extraordinario para mejorar el bienestar de la sociedad. De hecho, muchas aplicaciones ya ayudan a los médicos a tomar decisiones. El gran desafío es alcanzar la IA general, capaz de hacer una amplia variedad de cosas muy diversas. En los últimos años, lo que más me ha impresionado en IA es Alpha Fold, un software desarrollado por el Nobel Demis Hassabis, capaz de resolver el problema de cómo se pliegan las proteínas en el espacio tridimensional. Antes costaba mucho tiempo predecirlo y actualmente se hace en cuestión de pocas horas. Sin embargo, AlphaFold no es Generativa.

–Y su resultado es muy positivo.

–Por supuesto. Insisto en que la IA Generativa es solo una parte de la IA, pero, lamentablemente, es la parte que hace más ruido. Y es la que hace más ruido porque todo el mundo puede ahora usar ChatGPT. Por primera vez, en la calle, la gente sin conocimientos de la informática, puede y es consciente de que está interactuando con la IA. Y eso antes no pasaba. Y por eso se habla tanto. Porque cientos de millones de personas en el mundo han estado interactuando con ChatGPT.

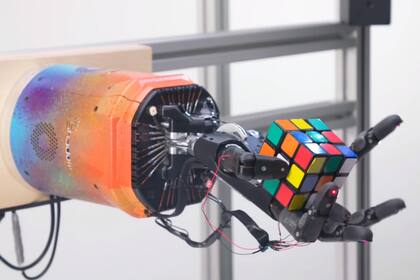

OpenAI desarrolló una mano robótica que, además de resolver el desafío, busca realizar otro tipo de tareas

OpenAI desarrolló una mano robótica que, además de resolver el desafío, busca realizar otro tipo de tareas–Quizá es por un tema generacional, pero de momento estoy invicta de ChatGPT.

–Es que si puedes hacer tu trabajo sin ChatGPT, es mucho mejor. Si lo usas estás poniendo en riesgo habilidades cognitivas. Ese es otro problema que veo con la IA generativa, la tendencia a delegar en la máquina la escritura, el escribir. La gente no se da cuenta que escribir es pensar. Porque antes de ponernos a escribir, pensamos mucho, organizamos nuestras ideas. Y nos enfrentamos a la página en blanco. Y cuando la página ya no está en blanco y al final terminas tu texto, sientes incluso una satisfacción. Si delegas todo esto en una máquina tu habilidad cognitiva para pensar se verá afectada. En definitiva, las consecuencias de renunciar a escribir pueden ser enormemente perjudiciales. Lamentablemente de esto se habla poco.

–¿Usted lo usa?

–Alguna vez he usado el ChatGPT para ver si me podía mejorar un poquito el estilo de un texto mío en inglés. Y pocas veces me lo ha mejorado. O las mejoras que me proponía me parecían absolutamente prescindibles o incluso pedantes. Lo he usado muy puntualmente. Solo en contadas ocasiones. Pero una cosa es usarlo con sentido común y otra muy distinta es abusar de él.

–Se cuida mucho de la vida digital, por lo que sé.

–No es bueno estar todo el día frente a las pantallas. Ni para el cuerpo ni para la mente. Trato de estar menos pendiente de todo lo digital. Prefiero el mundo analógico, practico el patinaje en línea, que es mi hobby, toco el piano, me quité de Linkedin, no hago compras por Amazon y navego lo imprescindible, prefiero hablar con los demás cara a cara. Esa es mi dieta digital. Tengo muy claro cuáles son las fuentes fiables y las no fiables de información. Intento usar mi pensamiento crítico. Hay quienes me dicen que a veces soy demasiado crítico y lo confunden con ser pesimista.

–¿Y no lo es?

–Soy tecnorrealista, pero sobre todo no soy tecnosolucionista. No pienso, como algunos, que la IA va a ser la solución a todos los problemas, los existentes y los que la propia IA crea. La solución tiene que venir de los humanos. De nosotros.

Recomendaciones para alcanzar una dieta digitalPreferir el mundo analógico al digital, hablar cara a cara con las personas, poco o nulo uso de redes sociales.

Proteger la privacidad deshabilitando cookies.

Denegar los pedidos de permiso para saber lo que uno está haciendo y así proteger el perfil.

Usar el modo incógnito.

Tapar la cámara para evitar el reconocimiento facial, a menos que sea una reunión por video.

Limitar compras por internet.

Caminar, interactuar con las personas y socializar.

Evitar la geolocalización en la medida de lo posible o permitir solo cuando no hay más remedio. Por ejemplo, buscar una estación de servicio cercana o un parking a mano

No hay comentarios.:

Publicar un comentario

Nota: sólo los miembros de este blog pueden publicar comentarios.