Claude Shannon. El Leonardo Da Vinci de la revolución digital que, sin embargo, sigue siendo casi un completo desconocido

El gran Claude Shannon es considerado el padre de la Era de la InformaciónX

En 1938, a los 22 años, escribió su tesis de maestría, en la que sentó las bases de la electrónica moderna; mantuvo un perfil muy bajo, pero su influencia fue colosal y está cada vez más vigente

Ariel Torres

Dedicarle un artículo a Claude Shannon es como escribir sobre Newton o sobre Einstein. No porque sí se lo ha comparado con ambos. Añadiría –y esto también alguien lo sugirió, al llamarlo “un renacentista”– a Leonardo Da Vinci, en cuya variedad de intereses se emparentan, así como en los incontables campos en los que ambos hicieron aportes.

Leonardo Da Vinci

Leonardo Da VinciEn los círculos de la electrónica, la computación, la criptografía y las telecomunicaciones, el apellido Shannon se pronuncia con reverencia. No fue tan solo un pionero. No solo fue un genio de esos que aparecen cada tanto. Fue una verdadera excepción, una de esas mentes que se ven pocas veces en la historia y que conecta dos ideas, dos campos, dos mundos de apariencia irreconciliable, y eso les da a las ciencias y a la tecnología un empujón hacia un nuevo paradigma. Por eso se lo conoce como el padre de la Era de la Información.

Casi cualquiera puede conectar dos ideas. Unos pocos pueden conectar dos ideas que no están en absoluto relacionadas entre sí. Pero solo un Newton concibe que la misma ley universal que hace caer una manzana del árbol es la que mantiene a la Luna en órbita. Y solo un Einstein percibe, derribando siglos de sesgos y de preconceptos, que la energía y la materia son equivalentes.

¿Qué hizo Shannon que ha llevado a sus colegas y alumnos (uno de ellos, Andrew Viterbi, cofundó el gigante de los chips Qualcomm) a compararlo con Newton y Einstein? Conectó dos ideas que estaban ahí, a la vista de todos –una de ellas tenía incluso un par de siglos–, y fundó lo que hoy llamamos la Era de la Información, sentó las bases de la digitalización y sembró las semillas conceptuales de la electrónica digital. Y lo hizo a los 22 años, con su tesis de maestría en el MIT.

Un paper, una fundación

Claude Elwood Shannon nació el 30 de abril de 1916 en Petoskey, Michigan, y pasaría gran parte de su infancia y adolescencia en un pueblo pequeño llamado Gaylord, donde asistió a la escuela pública. Luego se graduó con un título doble, en matemática e ingeniería, en la Universidad de Michigan (también una institución pública).

Llegó al Massachusetts Institute of Technology (MIT) de una forma inusual. Vio un aviso en el diario donde pedían alguien para trabajar en una nueva computadora, un analizador diferencial creado por Vannevar Bush. La máquina de Bush era analógica. Esto es, mecánica. Como Shannon también había estudiado matemática, tuvo un instante de iluminación y se hizo el siguiente planteo. Si de un lado tenemos el álgebra booleana y del otro lado tenemos la electrónica, ¿por qué no replicar los conectores lógicos de Boole mediante circuitos en lugar de engranajes?

Instituto Tecnológico de Massachusetts (MIT)Instituto Tecnológico de Massachusetts

Instituto Tecnológico de Massachusetts (MIT)Instituto Tecnológico de MassachusettsSe puso a trabajar y en 1938 defendió su tesis, titulada A Symbolic Analysis of Relay and Switching Circuits, lo que podría traducirse como Análisis simbólico de los circuitos de relés y conmutadores, y que se ha calificado como la Carta Magna de la Era de la Información y como el acta de nacimiento de la Revolución Digital. Se ha dicho, también, que es la tesis más influyente del siglo XX. ¿Por qué?

En suma

Por si no leíste el artículo sobre George Boole, este matemático inglés tuvo en 1847 una idea brillante. Tanto, que fundó una rama completa de la matemática, llamada álgebra booleana. ¿De qué se trata eso? Simple, de utilizar la lógica proposicional (o aristotélica) con números en lugar de con proposiciones y valores de verdad. Como en lógica solo hay dos valores (sí, hay lógicas con más de dos, pero no es el caso de la aristotélica), Boole reemplazó verdadero por el número 1 y falso por el 0 (da lo mismo al revés, obviamente). Así, por ejemplo, al conectar dos valores por medio del operador “Y”, el resultado será 1, si ambos valores son 1. Igual que en lógica, si pronunciamos una frase que conecta dos proposiciones mediante “Y”, ambas tienen que ser verdaderas para que el resultado sea verdadero. Por ejemplo, si hoy es sábado y llueve, solo será verdadero si decimos que es sábado y llueve. Si dijéramos que es martes y llueve, la frase completa sería falsa.

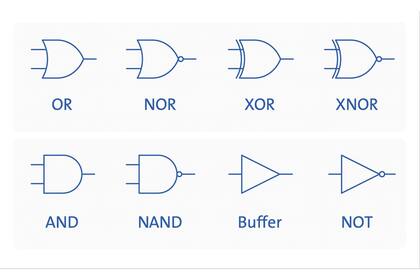

Los símbolos con los que se representan las puertas lógicas; la concepción de "puerta lógica" aparece por primera vez en la tesis de Shannon

Los símbolos con los que se representan las puertas lógicas; la concepción de "puerta lógica" aparece por primera vez en la tesis de ShannonUno de los operadores más potentes del álgebra booleana es el que hoy se conoce como XOR. El resultado de combinar dos proposiciones mediante XOR es verdadero solo si una de las dos es verdadera. Si ambas son verdaderas, el resultado es cero. Y si ambas son cero, también da cero.

El trabajo de Boole fue revolucionario, pero quedó en el topos uranos de las ideas. Mientras tanto, desde la década del ‘20 del siglo pasado, los ingenieros se rompían la cabeza haciendo malabares (a Shannon le fascinaba el malabarismo y estudió no solo la matemática de este ejercicio, sino que fabricó varios malabaristas mecánicos) para que las máquinas hicieran cálculo mediante métodos analógicos. Como el analizador diferencial de Bush.

Entonces llegó Shannon al MIT y advirtió algo que nadie más antes había visto. El álgebra booleana podía traducirse en unos circuitos especiales llamados puertas lógicas con los que podían resolverse problemas matemáticos de cualquier tipo. Hoy parece una cosa obvia. Pero lo que iba a dar origen a las computadoras, los celulares, Internet, la encriptación, la inteligencia artificial, el audio digital (desde los los sintetizadores hasta los CD) y los bitcoins, por citar solo un puñado de tecnologías, estaba planteado en ese paper. Una tesis de maestría. Vaya. Después algunos ponen en duda que la educación ha ido degradándose.

Por supuesto, como ocurrió con muchos otros desarrollos técnicos, no es que Shannon fue el único-único-único ser humano sobre la faz de la Tierra que pensó en circuitos electrónicos capaces de resolver álgebra. Casi simultáneamente, el ruso Víctor Shestakov y el japonés Akira Nakashima habían llegado a la misma conclusión. Con una diferencia. Shannon prefirió plantear una serie de lineamientos abstractos, que se podían aplicar entonces y que pueden aplicarse hoy. Nakashima, en cambio, estaba más aferrado a las tecnologías disponibles en su época.

En cuanto a Shestakov, no solo su trabajo es menos conocido por haberse desempeñado toda siempre en el Departamento de Física de la Universidad de Moscú, donde se había graduado, sino que su tesis y la de Shannon son del mismo año y ambas se publicaron en 1941. De todos modos, un dato es más importante respecto de Shestakov. Su carrera estuvo marcada por las restricciones y el secretismo del totalitarismo soviético, por lo que incluso si su obra fuera calcada de la de Shannon (o viceversa), las aplicaciones prácticas se basaron en el paper de Shannon, no en el de Shestakov.

Dicho más simple, Shannon trazó el marco teórico que nos permitiría, especialmente a partir del nacimiento del transistor, en 1947, crear circuitos lógicos. Lo extraordinario del trabajo de Shannon es que, al mantener una aséptica distancia respecto de las tecnologías del momento, formuló los principios matemáticos de la digitalización. Con esos principios, era posible mejorar las telecomunicaciones (Shannon trabajó en la telefónica Bell), comprimir información (los MP3 vienen de eso, por ejemplo, lo mismo que el formato ZIP), corregir errores (otro aporte de Claude) y encriptar datos (también fue uno de los padres de la criptografía). ¿Por qué tanto? Porque no se salió de los números, de la abstracción, de los símbolos. Luego podíamos ver si usábamos una tecnología u otra. Pero al ver al bit no como una unidad de almacenamiento sino de información, Shannon creó el equivalente ala ecuación E=mC² de la computación.

Dicho sea de paso, fue el primero en emplear la palabra bit, en su tesis de maestría, aunque con la aclaración de que el término había sido acuñado por John Tukey.

En pie de guerra

Pero hay más. Shannon se casó primero con la guionista Normal Levor, matrimonio que duró tan solo un año, y luego con una analista numérica a la que conoció en los laboratorios Bell, Mary Elizabeth Moore, que fue su mano derecha en muchos inventos y con quien pasaría el resto de su vida. Claude era un fabricante incansable de cosas extravagantes que él mismo calificaba como inútiles. Uno de esos inventos es un precursor de lo que hoy denominamos “entrenar un modelo de inteligencia artificial”. Solo que lo hizo en la década del ‘50, con la ayuda de Betty.

El aparato se llamaba Theseus (por Teseo, el héroe griego, rey de mítico de Atenas, que escapa del laberinto tras matar al minotauro) y era un ratón (con forma de ratón, anoten este dato, porque es testimonio de la inocencia con que se pensaban estas cosas por entonces) que trataba de salir de un laberinto. Con un adicional. Sus circuitos iban aprendiendo con el tiempo, por lo que Teseo, el ratoncito, se volvía cada vez más inteligente para resolver el problema. ¿Te suena?

Shannon conoció a Alan Turing durante la Segunda Guerra Mundial, y Einstein se metió en una de sus clases en Princeton una vez, por error, buscando dónde servían el té. Tuvo una participación clave en el desarrollo de los primeros métodos de cifrado modernos, especialmente en lo que concierne a las conversaciones telefónicas que mantenían Churchill y Roosevelt. También había trabajado en el control de defensas antiaéreas. En rigor, los aportes de Shannon en criptografía y telecomunicaciones dan para otros diez artículos como este. Lo dejaremos como un subtítulo para el lector curioso que quiera ahondar en esos tecnicismos deliciosos que, sin embargo, escapan al horizonte de eventos de esta nota.

La tesis doctoral de Shannon, de 1940, fue, sorprendentemente, sobre genética, pero al poco tiempo perdió el interés en este asunto y el trabajo quedó sin publicarse.

El enemigo silencioso

Shannon le concedió su último reportaje a la revista Omni (los que la recuerdan, lo hacen con cariño y nostalgia), en 1987 (el mismo año en que falleció Shestakov). Después de eso, sus apariciones en público se hicieron cada vez más esporádicas. A fines de los ‘90 se supo que el héroe de la revolución digital había caído víctima de una enfermedad cruel, despiadada y silenciosa, el mal de Alzheimer. Falleció en Medford, Massachusetts, el 24 de febrero de 2001, a los 84 años.

Callado, más bien tímido (aunque no retraído, según sus colegas), inmensamente humilde (al punto que le daba vergüenza dar charlas sobre su tesis de maestría, 40 años después de haberla publicado) y con una cierta tendencia a quedarse pensando y creando, en lugar de salir a hacer marketing personal, el autor de la idea que está detrás de cada circuito electrónico actual había dejado este mundo sin que su nombre saliera de los círculos más íntimos de la ingeniería, la matemática y la electrónica. Había cambiado el mundo, literalmente. Pero nunca saltó a la fama. Bueno, no se puede todo.

&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&&

Con la inteligencia artificial cada vez más integrada a parte de nuestra vida cotidiana, no faltan las polémicas en torno a atribuirle o no capacidades humanas a estas plataformas

Clarisa Herrera

Un número significativo de usuarios de servicio de inteligencia artificial considera que estos sistemas tienen algún nivel de conciencia propia y pueden pensar

Un número significativo de usuarios de servicio de inteligencia artificial considera que estos sistemas tienen algún nivel de conciencia propia y pueden pensarUna investigación publicada este año por el University College London y la Universidad de Waterloo encontró algunos hallazgos significativos en la percepción de los agentes de IA por parte de las personas: un 67% atribuyó algún grado de conciencia a ChatGPT y solo un tercio cree que ChatGPT no tiene experiencia subjetiva.

Si interactuar con una inteligencia artificial puede resultar similar a interactuar con una persona, podría ser lógico -según el estudio- asumir que los sistemas también tienen alguna suerte de capacidades humanas, como por ejemplo experimentar estados mentales. La autora principal del reporte, Dra. Clara Colombatto, profesora de psicología en la Facultad de Artes de Waterloo, lo afirmó en un comunicado de prensa: “Los hallazgos subrayan el impacto del lenguaje, una simple conversación puede llevarnos a pensar que un agente que luce y opera de manera muy distinta a nosotros podría tener una mente”.

El ejemplo clásico es el de Blake Lemoine, un ingeniero de Google especialista en inteligencia artificial que alertó en redes sociales, a mediados de 2022 (unos meses antes del debut de Chat, que una IA con la que venía trabajando había cobrado vida (o autoconciencia). Fue despedido de la compañía a finales de julio de este año.

Qué significa tener conciencia

Sofia Geyer, especialista en neurociencias y consultora en creatividad e innovación, explica que para la investigación se tomó una muestra de 300 personas a quienes les preguntaron si la inteligencia artificial podría llegar a tener conciencia, emparentando “conciencia” a la atribución de ciertas características de los humanos. “Lo más interesante es lo que más señalaron como posibles atributos humanos mentales en la IA: comunicación, capacidad de conocer cosas, memoria, decisión, consideración, capacidad de elección, inteligencia, planificación, atención y razonamiento. Los que menos asociaron fueron hambre, dolor, depresión, ansiedad, vergüenza, es decir, las emociones primarias humanas”, resalta.

El estudio reveló que una mayor familiaridad con ChatGPT está asociada con una mayor tendencia a atribuirle “conciencia” al modelo y esta familiaridad deriva de estilo conversacional al responder preguntas. “Más que pensar en si la inteligencia artificial tiene conciencia, el debate tiene más que ver con qué nos está empezando a pasar a los humanos cuando se empiezan a perfeccionar más las formas de comunicarnos con estos agentes, por eso según el estudio, quienes más estuvieron en contacto con los asistentes son los que más características humanas les atribuyeron”, destaca Geyer.

Vale resaltar que el descubrimiento evidencia una marcada diferencia entre la percepción del público y el punto de vista de los expertos, ya que la mayoría de los neurocientíficos y especialistas en el estudio de la conciencia consideran altamente improbable que los modelos de lenguaje tengan algún tipo de conciencia.

Según Geyer, una cuestión es atribuirle conciencia a una IA, pero otra cosa es entender como un ser humano percibe a un agente conversacional. “Los seres humanos somos seres sociales, tenemos cognición social, estamos todo el tiempo atribuyéndole intencionalidad al entorno y reaccionando en consecuencia por lo cual cuantas más características de interacción humana tenga el intercambio con estos agentes más características humanas es posible atribuirle a ese interlocutor artificial”, indica.

La frontera de las emociones

En el estudio se destaca que un riesgo de esta percepción es que una visión generalizada de que estos sistemas tienen emociones podría tener posibles implicaciones éticas y hasta niveles tóxicos -o potencialmente peligrosos- derivados de la confianza y la creencia en sus respuestas, capacidades o posibilidades. La firma Character.AI enfrenta al menos dos demandas por víctimas que se suicidaron luego de generar un vínculo emocional profundo con uno de los chatbots a medida que ofrece la compañía.

Profundizando un poco más, creer que los asistentes con IA tienen “conciencia” -alerta el paper- podría “formar conexiones emocionales más profundas con estos sistemas”, lo que sería al menos preocupante para áreas como la atención médica, la salud mental, el servicio al cliente y la educación. Lejos de verlo necesariamente como una consecuencia negativa, Francis Felici, líder de IA de Globant, considera que su capacidad de conciencia también se vincularía a una posibilidad de ser agentes de compañía: “Todo esto abre la posibilidad de la atención de personas mayores o de personas enfermas en un momento donde no sobra la solidaridad y sí son necesarias más que nunca las tareas de cuidado”, enfatiza.

En este sentido, Felici agrega que una pregunta derivada de la conciencia o no de estos agentes se relaciona a su posibilidad o no de acceder a derechos. “Estas IA pueden tranquilamente emular tener conciencia y emociones, pero es muy difícil probar si están emulando que tienen conciencia, o si realmente tienen conciencia. Pero también está el debate si el hecho de que emulen tener conciencia ya los hace tener conciencia. Si la tienen, viene toda la discusión de si se los puede tratar mal o cuáles son sus derechos, etc.”, comenta.

Cansadas y aburridas

¿Qué otras características humanas pueden ser atribuidas a las IA? En el marco del IAB NOW 2024, Marina Saroka, fundadora de Planetlambo, brindó una charla denominada “Prompteando los 7 pecados capitales de la IA” donde referenció otro estudio, publicado en 2023, donde se afirma que la instrucción “respira hondo y aborda este problema paso a paso” fue la más efectiva para mejorar la precisión de la inteligencia artificial PaLM 2 de Google (la predecesora de Gemini), según los investigadores de Google DeepMind. El insight -señaló la expositora- fue materia prima para que la marca KitKat lanzara una campaña con el mote “Have AI Break, Have A KitKat” (”tomate un descanso de la IA, comé un KitKat”, un juego de palabras con su slogan clásico).

El objetivo del estudio fue explorar cómo simples indicaciones podían optimizar el desempeño de modelos de lenguaje grandes, como GPT-4 de ChatGPT o Gemini de Google. Al utilizar esa frase, se encontró que el motor de Google logró un 80% de precisión al resolver una serie de problemas matemáticos de nivel escolar.

Los autores de los más de 8500 problemas matemáticos empleados en el estudio mencionaron que un “estudiante de secundaria destacado” debería ser capaz de resolver todos ellos. Sin embargo, sin esta indicación específica, el modelo alcanzó solo un 34% de precisión. En cambio, al pedirle que “piense paso a paso,” la precisión mejoró al 71%. Para identificar las frases más eficaces, los investigadores automatizaron el proceso de probar diversas indicaciones en distintos modelos de inteligencia artificial.

Felici cree que en este caso a lo que apunta la consigna del “descanso” es a evocar caminos de razonamiento en los modelos dependiendo de lo que uno quiera hacer. “Hay mucha evidencia -sobre todo de investigadores como Francois Chollet, el creador de Keras y una figura destacada en el mundo de la inteligencia artificial- que básicamente estos modelos de lenguaje son repositorios de caminos de razonamiento y toda la idea del prompt engineering es procurar evocar los caminos de razonamiento que sean más idóneos para la resolución de un problema. Hay otras técnicas similares, como decirle al modelo que haga siga un árbol de pensamientos determinado para resolver mejor la tarea”, indica.

En esta línea es interesante la anécdota que destaca de algunas semanas. Mientras un grupo de desarrolladores intentaban grabar una demostración de código en vivo de la última versión de Claude 3.5 Sonnet -la actual IA insignia de la compañía Anthropic- la IA decidió seguir otro camino por un rato, generando un momento divertido. “La tarea asignada tardaba varias horas; en el medio, la IA se aburrió y se fue a buscar fotos de un parque nacional en Estados Unidos, se quedó mirando las fotos un rato y después volvió a completar la tarea que estaba haciendo”, cuenta.

Geyer señala que se habla mucho de la inteligencia artificial, pero todavía no se sabe mucho de los mecanismos que originan la inteligencia y la conciencia humana: “Lo primero que deberíamos tener en claro es de qué hablamos cuando hablamos de conciencia y de inteligencia”, explica.

La especialista agrega que ninguna IA tiene la capacidad de experimentar de la misma manera del ser humano, porque según las más recientes investigaciones en el campo, el ser humano “siente con todo su cuerpo. Tenemos terminales nerviosas en cada parte de nuestro organismo. Para sentir, una IA debería tener todo el sistema biológico que tenemos los humanos y toda nuestra cognición social, situación que por el momento no ocurre”.

http://indecquetrabajaiii.blogspot.com.ar/. INDECQUETRABAJA

No hay comentarios.:

Publicar un comentario

Nota: sólo los miembros de este blog pueden publicar comentarios.